- JASホーム

- JASジャーナル

- JASジャーナル2023年秋号

- 高音質インターネット動画配信システム「Live Extreme」の進化

JASジャーナル目次

2023autumn

高音質インターネット動画配信システム「Live Extreme」の進化

株式会社コルグ 取締役/技術開発部 部長

大石耕史

概要

従来の動画配信システムは、音声はAACなどで不可逆圧縮されている場合が多く、音質が課題とされてきました。当社は、最大4Kの高解像度映像とともに、ハイレゾ・オーディオをライブ配信できる音質重視の動画配信システム「Live Extreme」を2020年に発表し、3年間で100公演以上の配信イベントで利用されてきました。本記事では、Live Extremeの技術解説を行うとともに、製品発表後に実施された機能強化、ビジネス展開、および配信実績についてご紹介します。

1. はじめに

新型コロナ・ウィルスの世界的な流行により、2020年以降、インターネットによるライブ配信市場は大きく伸長しました。しかし、従来の動画配信プラットフォームは映像が高解像であっても、音声はAACなどで不可逆圧縮されている場合が多く、音質面で十分満足できるものではありませんでした。

当社は、最大4Kの高解像度映像とともに、ハイレゾ・オーディオ(最大PCM 384kHz/24bitおよびDSD 5.6MHz)をライブ配信できる世界初※1の画期的なシステム「Live Extreme」を2020年9月に発表し[参考文献1]、同年11月に公開された「JASジャーナル」でも技術解説を行いました[参考文献2]。ただし、当記事を寄稿した時点では、機能も限定的で、配信実績は僅かに2公演しかありませんでした。

当社はその後もLive Extremeの開発を継続し、市場のニーズや現場での運用実態に合わせて機能強化を図るとともに、積極的なビジネス開拓を行ってきました。その結果、現在までに国内で100公演以上の配信イベントで利用されるに至りました。

本記事では、Live Extremeの高音質・高画質化技術について改めて解説するとともに、Live Extremeの新機能やビジネス展開についてもご紹介します。

※1 サンプリング周波数96kHzを超えるハイレゾ・オーディオに対応したインターネット動画配信システムとして(コルグ調べ)

2. Live Extremeの構成

2.1 配信システムの概要

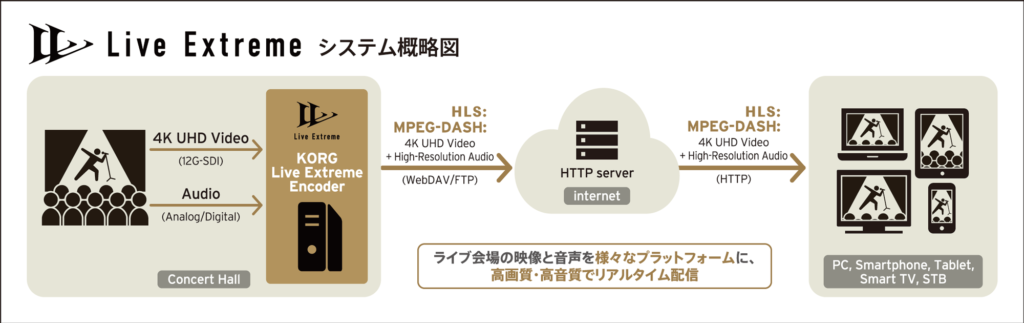

【図2-1】にLive Extremeのシステム概略図を示します。本システムは通常の配信システムと同様、配信会場に持ち込まれるライブ・エンコーダー、配信サーバー(プラットフォーム)、ストリーミング・プレイヤーの3つの要素から構成されています。その中で本システムの技術的な核であり、私たちが開発に注力しているのが、「Live Extreme Encoder」と名付けられたライブ・エンコーダーです。

2.2 配信システムの概要

【図2-2】の左下に映っている黒い機材が Live Extreme Encoderであり、これ 1 台で、映像と音声の取り込み、映像と音声の同期、動画フレーム変換、インターレース解除、エンコード、配信データの生成、配信サーバーへのアップロードまで完結させることができます。

Live Extreme Encoderは完全にソフトウェア・ベースで開発されており、上記ハードウェアも市販の動画キャプチャー・カードを搭載した Windows 10パソコンに過ぎません。

ソフトウェア・ベースであることには、

- (1) システム構築の際の導入コストを低く抑えることができる

- (2) 最新の技術を取り入れたり、導入先の都合に応じてカスタマイズすることが容易

- (3) 万が一、デバイスが故障しても、市場からすぐに代替品を調達することができる

というメリットがあるほか、将来的には配信事業者(企業)ではなく一個人による配信も視野に入れることができます。

| 動作環境 | OS | Windows 10 (64bit) 以降 |

|---|---|---|

| CPU | QuickSync Videoに対応したIntelプロセッサ | |

| ビデオデバイス | Blackmagic Design Decklinkシリーズ、またはUltraStudioシリーズ(12G-SDI, HDMI 2.0b対応) | |

| オーディオデバイス | ASIOに対応したオーディオ・インターフェイス | |

| 配信仕様 | 配信プロトコル | HLS, MPEG-DASH |

| 通信プロトコル | Amazon S3, FTP, WebDAV | |

| 映像 | コーデック | H.264 High Profile |

| 解像度 | 最大3840×2160 | |

| フレームレート | 最大60fps(2160p時は 最大30fps) | |

| ビットレート | 最大65Mbps | |

| 音声 | PCM | FLAC (最大7.1ch), Apple Lossless (最大5.1ch) 44.1kHz/16bit〜384kHz/24bit |

| DSD | 2.8224MHzまたは5.6448MHz (最大7.1ch) | |

| AURO-3D | Auro-Codec (最大7.1.4ch) 44.1kHz/24bit〜96kHz/24bit |

|

| Dolby Atmos | Dolby Digital Plus JOC (最大9.1.6ch) 48kHz / 384〜1024kbps |

3. 高音質配信を実現するための技術

動画配信の音質を向上させるには、ロスレスやハイレゾ・コーデックに対応するだけでなく、入り口から出口までの各ステップで音を適切に取り扱う必要があります。本章では、Live Extremeにおいて音質を担保するために実施している主なポイントについてご紹介します。

3.1 外部オーディオ・インターフェイスへの対応

ビデオ機器に搭載されているオーディオ入力端子よりも、オーディオ専用機器の方が、S/Nや周波数特性、クロック精度に優れたものが数多く存在します。Live ExtremeはSDIやHDMIのビデオ信号に重畳されたオーディオ信号(エンベデッド・オーディオ)以外に、USBオーディオ・インターフェイスなど外部オーディオ機器からオーディオ信号を取り込むことができます。当社製品はもちろんのこと、ASIOにさえ対応していれば、他社の製品もLive Extreme Encoderのオーディオ入力装置として使用することができます。

これには音質的なアドバンテージはもちろんのこと、過去20年間、多種多様なASIOデバイスが発売されていることから、

- アナログ(XLR, TRS, RCA等)

- S/PDIF(coaxial, optical)

- adat

- AES/EBU

- MADI

- DANTE(Dante Virtual Soundcardを含む)

など、配信現場の環境に合わせて、任意の入力インターフェイスを選択できる利点もあります。

3.2 オーディオ・クロックを軸とした映像との同期

ビデオ信号にオーディオ信号を重畳するには、両者をクロック単位で同期させる必要がありますが、ここにも音質的な問題が存在します。ビデオにオーディオを重畳する装置(エンベッダ)の内部では、オーディオ・クロックをビデオ・クロックからPLLで生成したり、オーディオ信号にASRC(非同期サンプルレート・コンバータ)を掛けることによって同期を実現していることが多いためです。

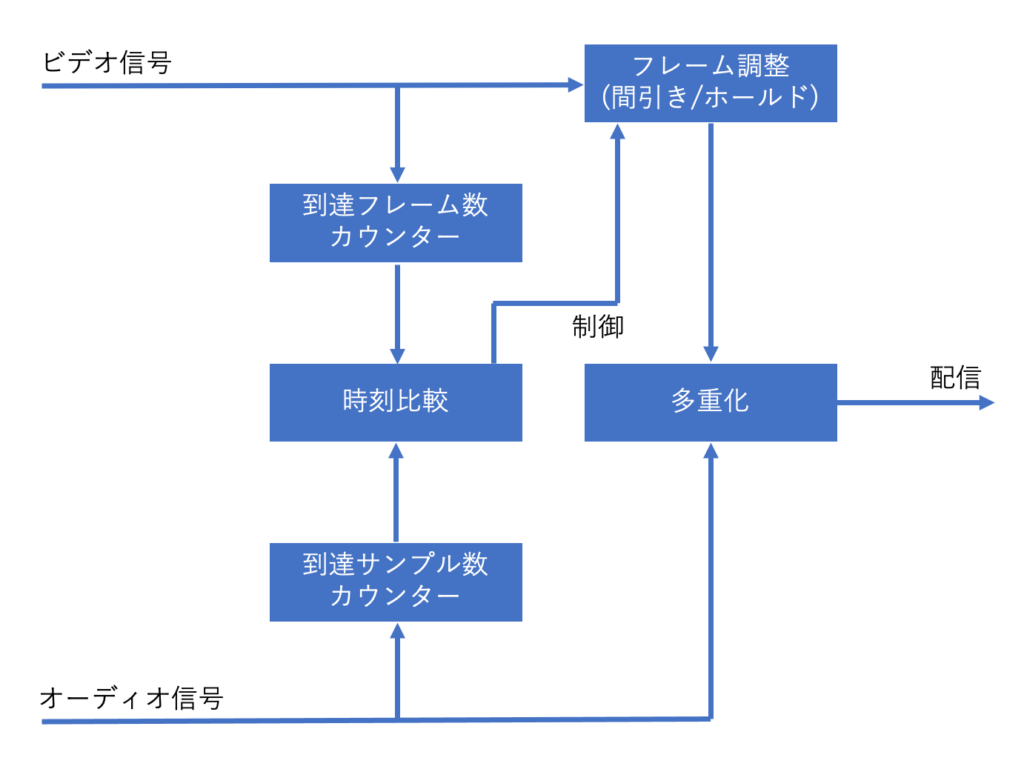

この問題を回避するために、Live Extremeでは、音声信号を無理に映像クロックと同期せずに、音質的に有利なフリーランで収録することを推奨しています。この状態だと映像と音声が徐々にずれていく「ドリフト」と呼ばれる現象が発生しそうなものですが、本システムには【図3-1】で示される独自の同期補正機能が搭載されているため、問題は生じません[参考文献3]。

この機能は、システムに到達するビデオ信号のフレーム数とオーディオ信号のサンプル数を常に監視しており、1フレーム以上の差異が認められた場合は、ビデオ・フレーム側を間引くまたはホールドすることによってズレを即座に解消します。いわば音声信号に映像を合わせる同期方法によって、音声は1サンプルも変化することなくビット・パーフェクトで配信されます。

3.3 ロスレス・オーディオ・コーデックへの対応

Live Extremeは、標準音声フォーマットとしてロスレス・コーデックのデファクト・スタンダードであるFLAC (Free Lossless Audio Codec)を採用しています。FLACは規格上最大655.35kHz/32bit×7.1ch音声までサポートしており[参考文献4]、現在では殆ど全てのウェブ・ブラウザで再生することができます。

なお、Live Extremeは、旧macOSとの再生互換性を確保するため、Apple Lossless (ALAC)音声の配信にも対応しています。

3.4 DSD (Direct Stream Digital)への対応

Live ExtremeはハイレゾPCMのみならず、SACD (Super Audio CD)に採用されている1bit DSD信号の配信にも対応しています。1bit信号はサンプルレート・コンバータを通すとマルチビットになってしまうため、慎重に取り扱う必要がありますが、前述の「オーディオ・ファースト同期」機能がここで威力を発揮します。

Live Extreme Encoderは、外部オーディオ・インターフェイスによって1bitでA/Dされた信号を「DSD over PCM frames (DoP)」規格によりPCMフレーム内に格納した上で、FLACやApple Losslessフォーマットで伝送します。この信号は、ストリーミング・プレイヤー(ウェブ・ブラウザ)からKORG Nu 1などDoP対応USB-DACにビット・パーフェクトで伝送することで、ネイティブ再生が可能です。

3.5 マルチチャンネル音声への対応

Live Extreme EncoderにはSDIやHDMIのエンベデッド・オーディオや、外部接続されたマルチチャンネル・オーディオ・インターフェイスから任意の12chを選択し、サラウンド配信できるほか、最大4つのオーディオ・ストリーム(副音声)を同時配信する機能が備わっています。この機能を活用することで、

- 7.1ch (5.1ch)サラウンド音声 + 2chステレオ・ミックス

- 2chステレオ音声 + 2chバイノーラル音声

- 音楽演奏 + オーディオ・コメンタリー

など、多彩な配信を実現できます。

なお、同時配信されたオーディオ・ストリームは、ストリーミング・プレイヤーのGUIからユーザーが任意のものを選択して再生することができます。

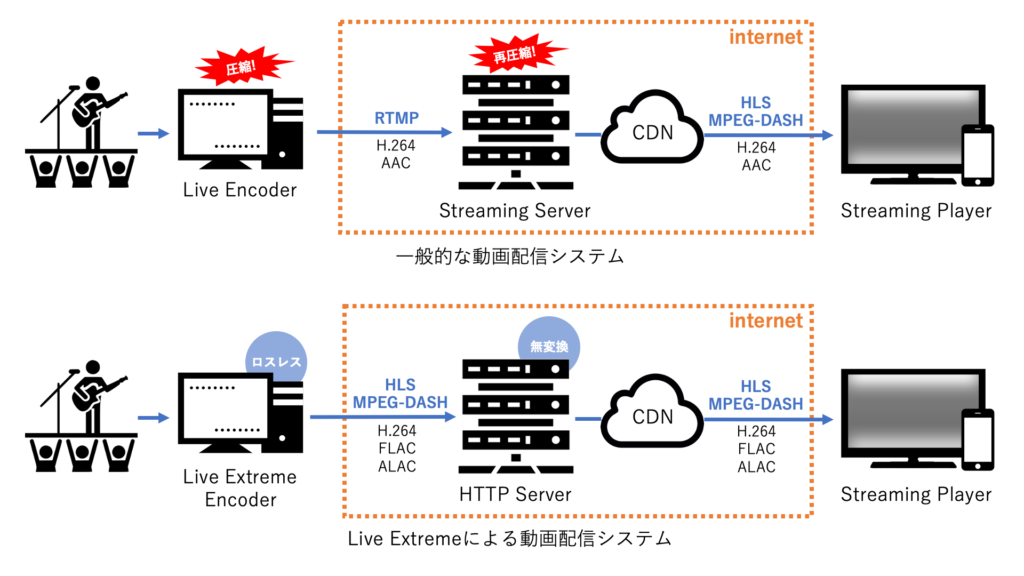

3.6 HLS / MPEG-DASHダイレクト・アップロード

旧来の動画配信システムでは、映像と音声がライブ・エンコーダー内でH.264とAACに非可逆圧縮され、RTMPプロトコルで配信サーバーに打ち上げられます。ここで、配信サーバーはHLSやMPEG-DASHといったウェブ・ブラウザで再生可能な形式に変換した上で、視聴者に配信することになります。

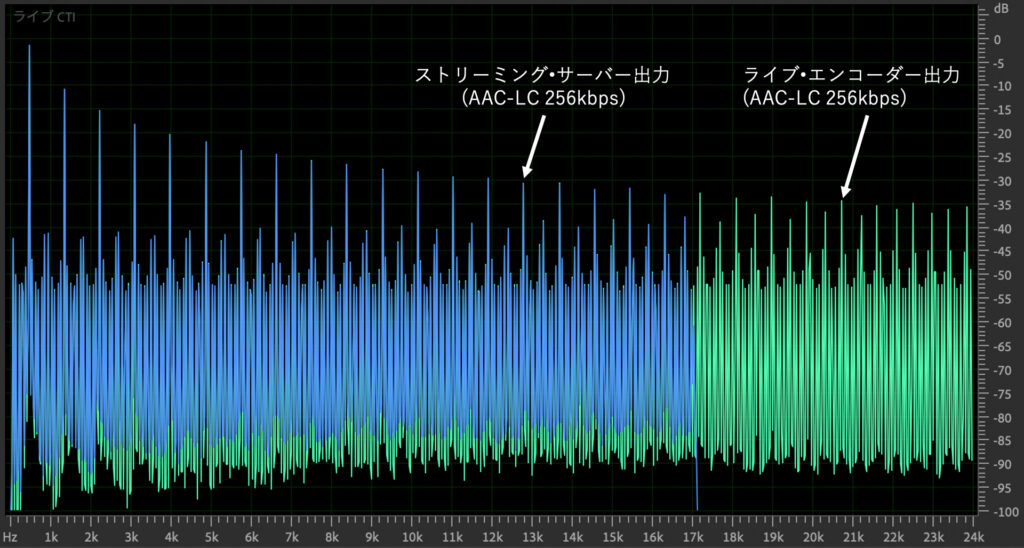

配信サーバーの入出力はどちらもH.264+AACなので、ここで映像と音声の劣化は発生しないように思いがちですが、実際はほとんどの配信サーバー内でデータの再圧縮(デコードと再エンコード)が行われ、映像も音声も劣化することが確認されています。【図3-4】は440Hzの矩形波を配信した時のライブ・エンコーダーの出力と配信サーバーの出力を比較したものですが、明らかな差が見てとれます。

一方、Live Extremeは、視聴者が受信して再生するデータそのものをライブ・エンコーダー内で生成し、配信サーバーはこれをパススルーする仕組みになっています。このため、ロスレス圧縮される音声が劣化しないのはもちろんのこと、映像もストリーミング・サーバー内での再圧縮を回避できるため、高画質なまま配信することができます。

【図3-5】一般的な動画配信システムとLive Extremeの比較

4. ストリーミング・プレイヤーの特長

Live Extremeの再生には、基本的に専用のネイティブ・アプリケーションは不要で、フリーで利用可能なオープンソースの「Shaka Player」が標準プレイヤーとして指定されています。これはウェブ・ブラウザ上で実行可能なJavaScriptベースのプレイヤーであるため、以下のようなアドバンテージがあります。

- (1) 再生環境のマルチプラットフォーム化が容易(【表4-1】参照)で、メンテナンス・コストも低く抑えることができる

- (2) 既存のウェブサイトやSNSからのサービス導線に優れている(プレイヤーをウェブページ内に埋め込むことも可能)

- (3) 課金システムやデータベース、DRMなど既存のウェブ・インフラを活用できる

- (4) 配信事業者自身がプレイヤーを自由にカスタマイズすることができる

Live ExtremeはOS標準のマルチメディア再生フレームワーク(「AVPlayer」、「ExoPlayer」)や、「VLC」を始めとするオープンソースのネイティブ・プレイヤーとの再生互換性も取れていますので、配信サービス独自のネイティブ再生アプリを開発することも容易です。

| デバイス/OS | アプリ | 対応状況 |

|---|---|---|

| Windows 10/11 | Microsoft Edge Google Chrome |

◎ |

| Mozilla Firefox | ○ | |

| macOS | Apple Safari Google Chrome |

◎ |

| Mozilla Firefox | ○ | |

| iPhone / iPad | Apple Safari | ○ |

| native app*1 | ◎ | |

| Android | Google Chrome | ◎*3 |

| Live Extreme Experience*1 *2 | ◎*3 | |

| Fire TV | Amazon Silk | ○ |

| Apple TV | AirPlay | ○ |

| Android TV / Chromecast | Google Cast | ○ |

◎: ハイレゾ音声までフル対応 ○: ロスレス音声に対応

※実際にサポートされるOSやアプリは、配信サービス提供者によって異なります

*1 配信サービス提供者に技術支援可能

*2 コルグ開発のネイティブ・アプリケーション

*3 ハイレゾ対応Android DAP使用時

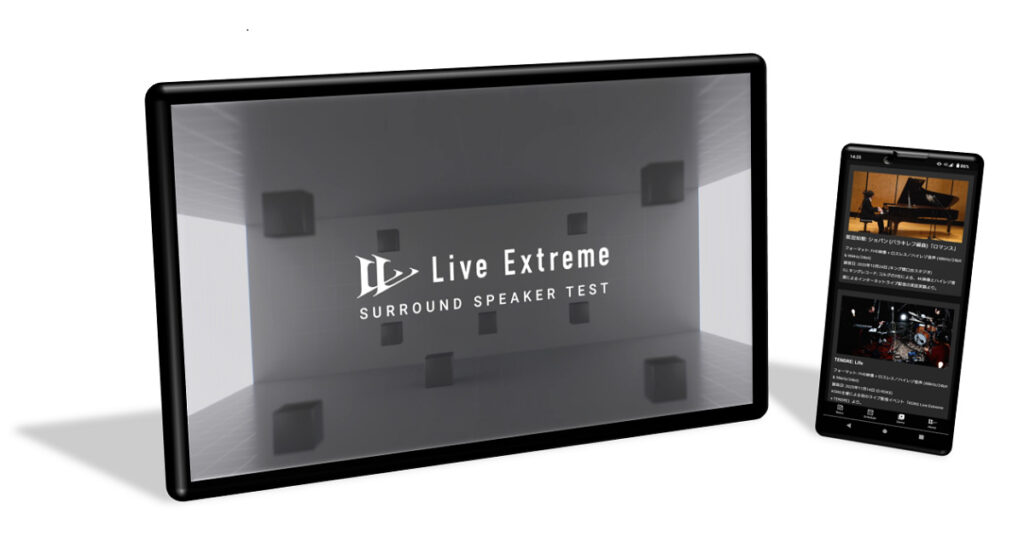

5. 立体音響配信への対応

Live Extremeのハイレゾ配信技術は、2021年7月のアップデートで、PCM 384kHz/24bit×8ch、DSD 5.6MHz×8chのビット・パーフェクト伝送を実現したことで、原理的に実現可能な最高スペックに達することができました。しかし、ここで音響面の進化が止まったわけではなく、2022年以降は立体音響の分野に開発を注力しています。

本章では、Live Extremeの新機能である立体音響配信技術についてご紹介します。

5.1 HPL

HPL (Headphone Listening)は、株式会社アコースティックフィールドが開発し、2014年より数多くのハイレゾ作品やTV放送で採用されているバイノーラル・プロセッシング技術です。市場にバイノーラル・プロセッサーはたくさんありますが、HPLは音楽再生を考慮した設計がなされているのが特長です[参考文献5]。

Live Extreme Encoder(v1.10以降)は、オーディオデバイスから入力された信号に対して、リアルタイムでHPLプロセッシングを行い、ライブ配信することができます。

| コーデック | FLAC, Apple Lossless |

|---|---|

| サンプリング周波数 | 44.1kHz, 48kHz, 88.2kHz, 96kHz, 176.4kHz, 192kHz |

| チャンネル・レイアウト | 2ch (HPL2), 5.1ch (HPL5), 7.1ch (HPL7) 5.1.4ch (HPL9), 7.1.4ch (HPL11) |

5.2 AURO-3D

AURO-3Dは、ベルギーのNew Auro社が提供するイマーシブ・オーディオ・フォーマットです。AURO-3Dにはいくつかのコーデックが存在していますが、家庭用に開発されたチャンネル・ベースの「Auro-Codec」は、最大96kHz/24bitのハイレゾ音声を “ニア・ロスレス” で伝送することが可能[参考文献6]で、Blu-ray Discやダウンロード配信サービスなどに利用されてきました。

Live Extremeは、2023年4月にAURO-3Dの疑似ライブ、およびオンデマンド配信に対応しましたが、「Live Extreme Encoder v1.12」(2023年11月リリース)からは、リアルタイム配信にも対応する予定です。

| コーデック | Auro-Codec |

|---|---|

| コンテナ | FLAC, Apple Lossless |

| サンプリング周波数 | 44.1kHz, 48kHz, 88.2kHz, 96kHz |

| チャンネル数 | 5.1.4ch, 7.1.4ch |

5.3 Dolby Atmos

Dolby Atmosは、米Dolby Laboratoriesが開発した立体音響技術[参考文献7]で、他社類似技術に比べ、対応サービスやコンテンツ数、再生環境ともに最も充実しています。家庭用のDolby AtmosにはBlu-ray Discに採用されたDolby TrueHDなどいくつかの対応コーデックが存在していますが、映像コンテンツのストリーミング配信では、主にDolby Digital Plusが利用されています。

Live ExtremeでもDolby Digital Plusを用いたDolby Atmos配信が利用可能ですが、2023年10月現在、ライブ配信には対応しておらず、疑似ライブ、およびオンデマンド配信のみに対応しています。

| コーデック | Dolby Digital Plus |

|---|---|

| サンプリング周波数 | 48kHz |

| ビットレート | 384, 448, 576, 768, 1024 kbps |

| チャンネル数 | 最大16/JOC |

| 配信方式 | 疑似ライブ配信(リニア配信)、オンデマンド配信 |

従来Live Extremeは専用アプリを提供せず、ウェブ・ブラウザ再生を基本としてきました。Dolby Atmosについても、ほとんどの環境でウェブ・ブラウザ再生(またはキャスト再生)ができることを確認していますが、唯一Android端末ではDolby Atmosのウェブ・ブラウザ再生ができないことが分かっています。

この問題に対処するため、当社では2023年8月に「Live Extreme Experience for Android」というネイティブ再生アプリケーションをリリースしました。このアプリをインストールすることで、Live ExtremeのDolby AtmosコンテンツをAndroid端末の内蔵スピーカーやヘッドホンで再生することが可能となります※2。

※2 Dolby Atmos (DAX)対応端末のみ

【図5-1】Korg Live Extreme Experience for Android

| デバイス/OS | 再生アプリ | 備考 |

|---|---|---|

| Windows 10/11 | Microsoft Edge Google Chrome |

Dolby Atmos非対応機種は「Dolby Access」のインストールが必要 |

| Mac | Apple Safari | 2018年以降のMacBookシリーズ |

| iPhone | Apple Safari | iPhone XSシリーズ, iPhone XR, iPhone SE (第2世代), iPhone 11以降 |

| iPad | Apple Safari | 2018年以降のiPad Pro, iPad Mini, iPad Air |

| Android | Korg Live Extreme Experience | Dolby Atmos (DAX) 対応Android端末のみ |

| Apple TV 4K | AirPlay | Safariブラウザ (Mac, iPhone, iPad) からのキャストに対応 |

| Chromecast Ultra, Chromecast with Google TV |

Google Cast | Chromeブラウザ (Windows, Mac, Android)、およびKorg Live Extreme Experience からのキャストに対応 |

6. 配信プラットフォーム/サービス

配信サービスを運用するには、配信エンコーダーやストリーミング・プレイヤーはもちろんのこと、配信プラットフォーム(配信サーバー、課金システムなど)が必要になってきます。当社が現時点で提供しているのは、配信エンコーダーやその周辺の配信技術のみであり、配信プラットフォームは配信事業者に別途ご用意いただく必要があります。

Live Extremeの配信サーバーは「Amazon S3」というクラウドサービスを利用することで容易に構築可能ですが、当社では、配信主催者がより簡単な手続きでLive Extreme配信を実現できるよう、国内の各配信プラットフォーマーとの提携を進めてまいりました。その結果、独自配信プラットフォームを構築せずとも、下記の会社やサービスを通じて、Live Extreme配信を手軽にご利用いただけるようになっています。

- 輝日株式会社(eContent)

- イベキャス

- 株式会社インターネットイニシアティブ(IIJ)

- 株式会社Jストリーム

- 株式会社フェイス(Thumva)

上記は全て国内の会社/サービスですが、2023年10月にアメリカを拠点とする配信プラットフォーム「Artist Connection」との提携が実現したことにより、今後、米国や欧州での配信も増えていく見込みです。

7. 利用実績

Live Extremeは現在でも業界随一のスペックを誇り、かつ導入障壁も低いため、過去3年間に多くのシーンで利用されてきました。ここではLive Extremeの主な利用実績についてご紹介します。

7.1 イベントでの利用

2021年以降、下記を含む100公演以上のイベントでLive Extremeが利用されてきました。4K映像 + ハイレゾ音声はもちろんのこと、マルチアングル配信、バイノーラル配信、副音声付き配信、DSD配信、立体音響配信など、配信主催者のご要望に応じて、多種多様な配信が行われています。

| 公演名 | 配信日 | 内容 |

|---|---|---|

| 新日本フィルハーモニー交響楽団「愛と戦闘のバレンタイン」 | 2021年2月 | マルチアングル映像 + 192kHz/24bitハイレゾ音声によるライブ配信 |

| 東京・春・音楽祭2021 | 2021年3~4月 | ベルリン・フィルハーモニー管弦楽団の演奏会を含む10公演を配信 |

| 象眠舎「Live at Cotton Club」 | 2021年11月 | HPLによる音楽演奏(主音声) + 出演者のオーディオコメンタリー(副音声)による配信 |

| 羊文学「まほうがつかえる 2021」 Online Show |

2021年12月 | ビルボードライブ横浜からフルHD映像 + 48kHz/24bitロスレス音声をライブ配信 |

| 熊川哲也Kバレエカンパニー 「くるみ割り人形 in Cinema」 |

2022年1月 | 4K映像 + 48kHz/16bit 5.1chロスレス音声によるオンデマンド配信 |

| OTOTEN 2022 ライブ配信セミナー |

2022年6月 | “空気録音”をステレオ(主音声)とバイノーラル(副音声)によってライブ配信 |

| Ron Carter & Blue Note Tokyo All-Star Jazz Orchestra |

2022年8月 | ブルーノート東京から4K映像 + 96kHz/24bitハイレゾ音声をライブ配信 |

| Special Live 大友良英 + 小山田圭吾 |

2023年4月 | 一般向けには世界初となるフルHD映像 + DSD (2.8MHz) 音声によるライブ配信 |

7.2 教育機関での利用

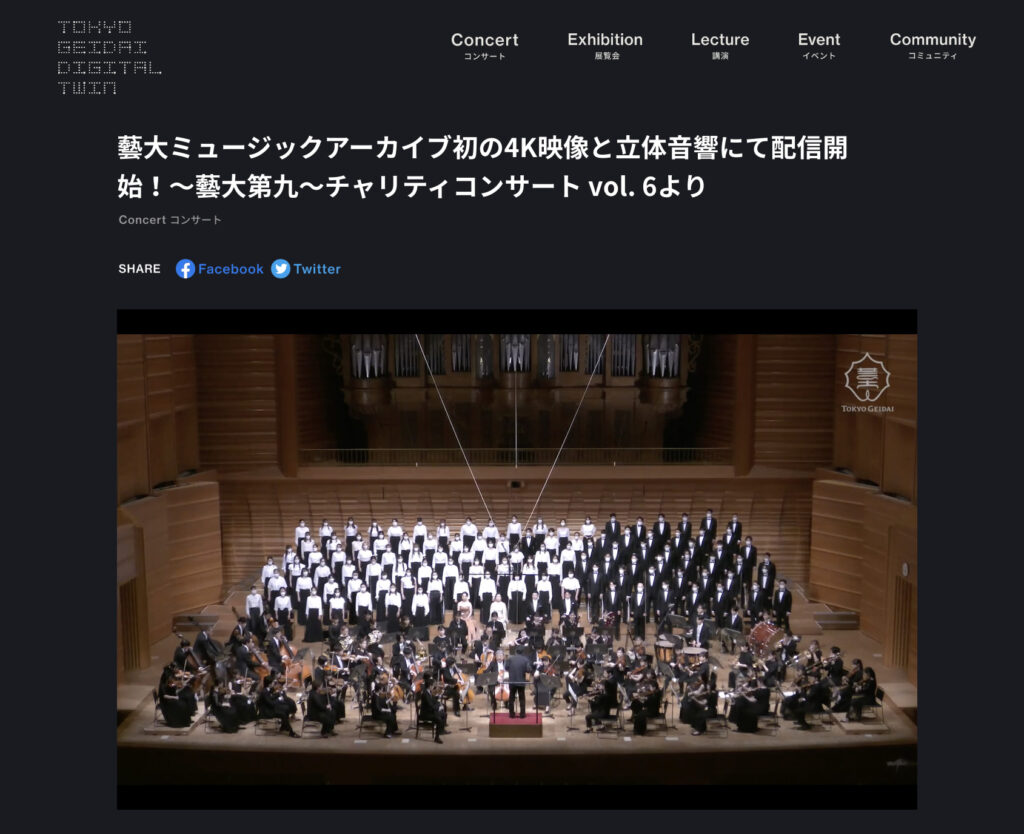

当社では2023年4月より、Live Extremeの技術を用いて、高音質・高画質動画の配信アーカイブ構築をサポートするフルマネージド・サービス「Live Extreme Showcase」の提供を開始しました。このサービスを活用して、東京藝術大学が「藝大ミュージックアーカイブ」のコンサート配信から選りすぐりの公演を高音質化し、「東京藝大デジタルツイン」のサイトにて順次公開しています。その第一弾コンテンツである「藝大第九〜チャリティコンサートvol.6〜」は、4K映像 + ハイレゾ96kHz/24bitのAURO-3D 9.1ch音声で配信されました。

Live Extremeは名古屋芸術大学でも利用され、2023年8月に開催された「名古屋芸術大学フィルハーモニー管弦楽団 第11回定期演奏会」がDolby Atmosで配信されています。

また、九州大学 大学院芸術工学研究院 音響設計部門(城一裕准教授)は「特異な音響空間内における音を知覚する体験の設計とその配信技術の開発」(科研費 挑戦的研究(開拓) 23K17267)という研究を行うためにLive Extremeを導入。当社と共同で「原音場の再現性に優れたアンビソニックスと、時間領域での再現性が極めて高いDSDとを組み合わせた技術」を開発し、配信という形で共有していく予定です。

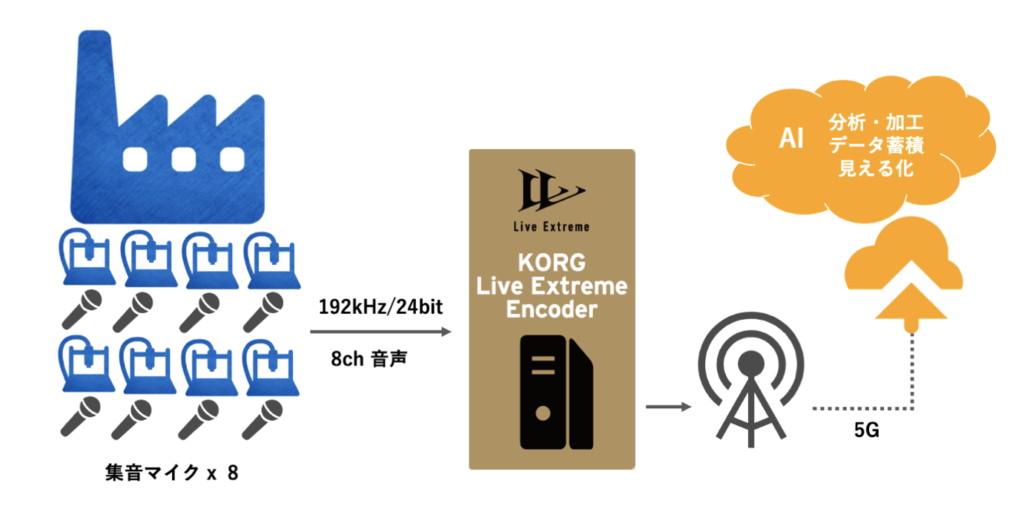

7.3 産業での利用

Live Extremeは2022年に、総務省の「タイ王国工業団地内におけるローカル5Gを活用したアプリケーション実証試験」でも利用されました[参考文献8]。これは、タイ王国アマタシティ・チョンブリ工業団地にあるダイキン インダストリィ タイランドの工場から、機械の動作音を8本のマイクで同時収集した非圧縮音声データ(192kHz/24bit)を、ローカル5Gネットワーク経由でクラウドサーバへ送信。クラウド上でAI分析することで、機械の稼働監視や故障予兆を検知し、予防保守によるコスト削減と保守作業の効率化、作業員の負荷軽減を目指したアプリケーションでした。

8. まとめ

Live Extreme発表より丸3年が経過しました。国内では対応プラットフォームや常設会場が増え、毎月のようにLive Extreme配信が実施されるようになってきました。技術面でもマルチチャンネル音声や立体音響配信対応、AWS連携など、配信システムとしての魅力は3年前とは比べ物にならないほど向上しています。今後は海外でのビジネスを強化するとともに、バーチャル・リアリティなど、より高い臨場感が求められる分野に進出すべく準備を進めています。

最後になりますが、弊社は2023年3月から日本オーディオ協会の正会員となりました。会員の皆様と共に、ハイレゾや立体音響をしっかりと盛り上げてまいりたいと考えておりますので、引き続きよろしくお願いいたします。

参考文献

- [1] 株式会社コルグ, プレスリリース「コルグが業界史上最高音質によるインターネット動画配信システム『Live Extreme』を開発。」(2020年9月10日)↑

- [2] 大石耕史「“高音質”インターネット動画配信システム『Live Extreme』」(JAS Journal Vol.60 No.6, 2020年11月)↑

- [3] 「再生制御装置、再生制御方法、およびプログラム」(特許第696385号)↑

- [4] A. Weaver「draft-ietf-cellar-flac-12」(2023年9月27日)↑

- [5] 久保二郎「今すぐに楽しめるバイノーラル音楽作品と高音質バイノーラル技術『HPL』」(JAS Journal Vol.61 No.4, 2021年11月)↑

- [6] Bert Van Daele, Wilfried Van Baelen「AURO-3D OCTOPUS CODEC: Principles behind a revolutionary codec」(2011年11月)↑

- [7] ドルビージャパン(株)「ドルビーの魔法: カセットテープからDOLBY ATMOSまでの歩みをたどる」(2019年5月)↑

- [8] 日本公営, KDDI, プレスリリース「日本公営とKDDI、タイ工業団地でローカル5G実証実験」(2022年1月24日)↑

執筆者プロフィール

- 大石耕史(おおいし こうじ)

2002年、株式会社コルグ入社。デジタル・シンセサイザーの開発を経て、2004年より1ビットオーディオの研究開発を開始。その成果物としてMRシリーズやAudioGate、PrimeSeat等をリリース。2023年より現職。同社の新規技術や新機軸商品の開発を統括する。